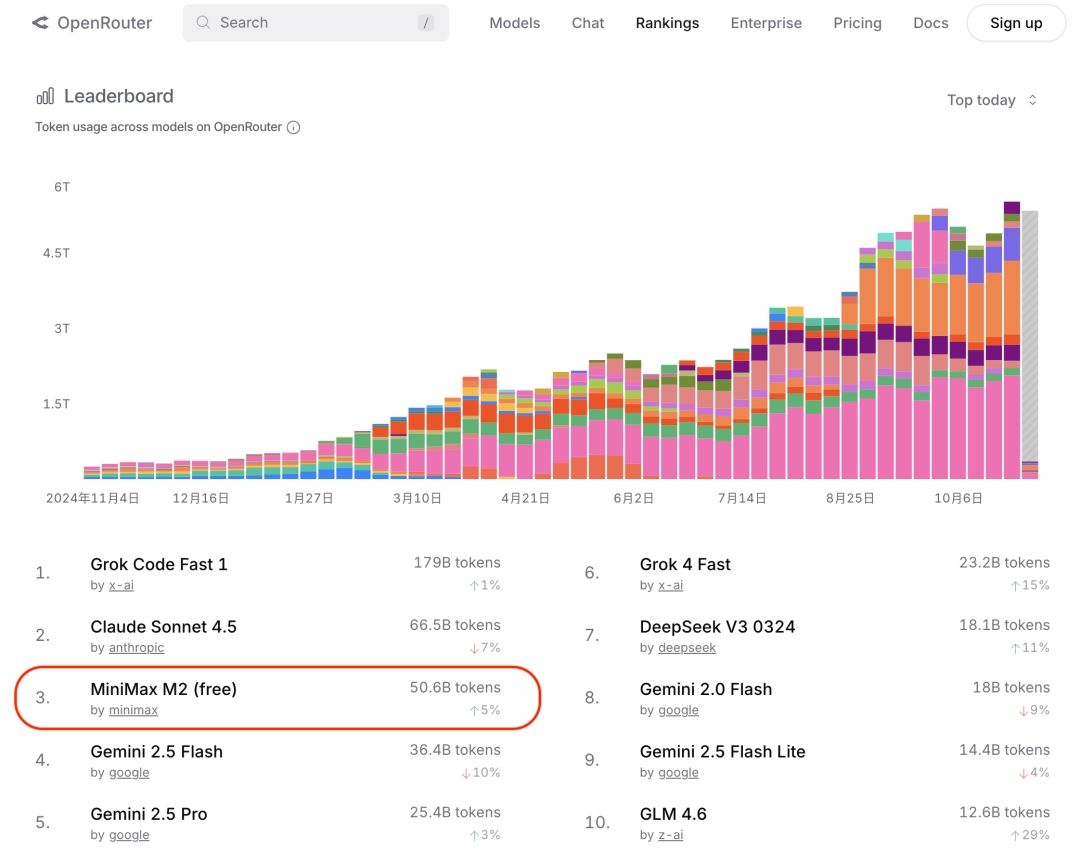

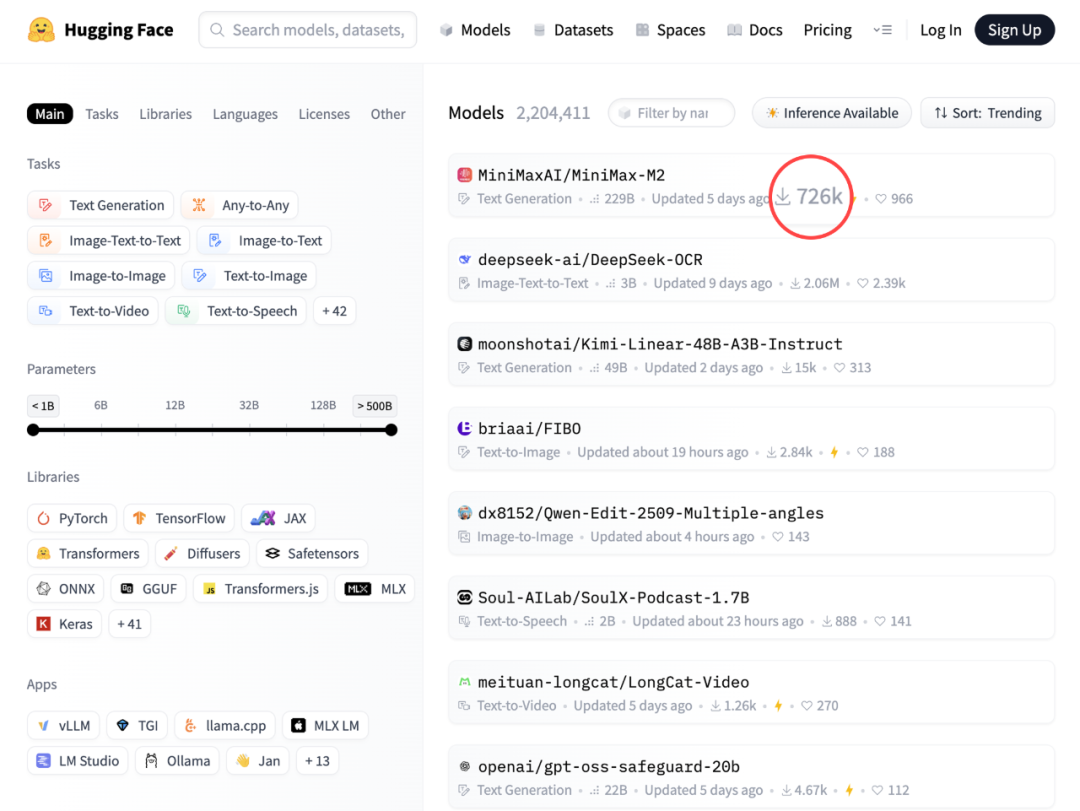

自发布起,海内外社区中越来越多的开发者开始使用 MiniMax M2,几天内M2已跃升为OpenRouter全球调用量前三、HuggingFace Trending全球第一的模型。M2是OpenRouter上第一个日token消耗量超过50B的中国模型。

M2调用量位居OpenRouter全球调用量前三

M2在HuggingFace Trending榜单中位列全球第一

在 M2研发的早期阶段,我们就发现了Interleaved Thinking(交错思维链)在Agent和Coding应用中的重要性。除 Anthropic Claude 外,目前大多数模型还未完全支持Interleaved Thinking,它仍是业内的非共识。从用户反馈中我们也注意到,Interleaved Thinking在实际应用中有时并未被正确使用。为什么Interleaved Thinking重要,以及如何在不同API接口中有效地使用Interleaved Thinking以获得最佳效果?我们想分享一些内部思考。

为什么 Interleaved Thinking 如此重要?

Interleaved Thinking 对 Agent 至关重要:它指在显式推理(reasoning)与工具调用(tool use)之间交替进行,并把推理结果持续带入后续步骤。这一过程能显著提升在长程任务中的规划能力、自我修正能力与可靠性。在实践中,它将冗长、重度依赖工具的任务转化为稳定的“计划→行动→反思”循环,减少状态漂移与重复性错误,同时确保每一步行动都基于最新证据(evidence)。Interleaved Thinking同时提升了可调试性:通过推理过程的快照让故障变得可解释与可恢复,并通过复用假设、约束与部分结论(而不是重新推导每个步骤)从而提高样本效率。为获得最佳效果,与其在一开始完成所有思考,不如将思考与工具反馈交错进行,保持思维链的连贯性,使其在多轮交互中不断累积。

从社区开发者反馈中,我们发现部分失败案例源于没有正确使用 Interleaved thinking,即未能在多轮会话之间保留之前每一轮的思考状态。问题的原因之一是,社区广泛使用的OpenAI Chat Completion API并不支持返回推理内容,并在后续请求中再次传递。Anthropic API 虽然原生支持该能力,但社区对 Claude 之外的模型支持得较少,并且许多应用在其Anthropic API的实现中仍然没有回传之前的思考过程。这种情况导致 Interleaved Thinking 并没有得到良好的支持。而为了完全释放 M2 的全部能力,在多轮交互中保留思考过程至关重要。

在MiniMax M2中,只有保留并把上一轮的推理反馈到后续轮次,Interleaved CoT才能发挥最大效果。模型会在工具调用之间进行推理,将计划、假设、约束与中间结论持续向后传递——正是这种可持续、可累积的推理状态让M2模型稳定可靠。一旦丢弃了之前的推理状态,模型的累积理解能力会下降,状态偏离会增加,自我修正能力会减弱,规划能力也会退化,尤其在长程(long-horizon)工具调用和“运行–修复”循环中更为明显。

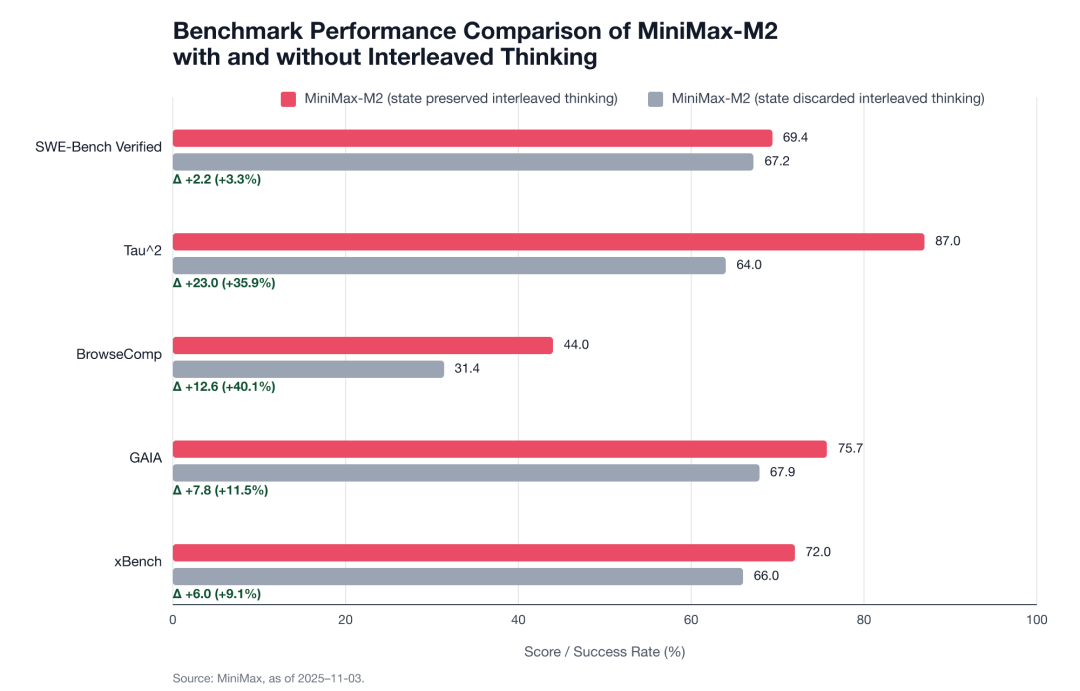

多项基准测试表明,保留之前多轮交互的思维状态更能提高性能:

SWE‑Bench Verified:69.4 vs. 67.2 (Δ=+2.2; +3.3%)

Tau^2:87 vs. 64 (Δ=+23; +35.9%)

BrowseComp:44.0 vs. 31.4 (Δ=+12.6; +40.1%)

GAIA:75.7 vs. 67.9 (Δ=+7.8; +11.5%)

xBench:72.0 vs. 66.0 (Δ=+6.0; +9.1%)

保持 Interleaved Thinking 状态完整至关重要 —— 模型的可靠性不仅在于它当前的想法,更在于它能否回顾和修正之前的想法。Interleaved Thinking 把这一过程机制化:计划 → 行动 → 反思,且状态始终保留,让反思得以累积,让修正在多轮交互中传递。

图解 Interleaved Thinking

解锁M2的 Interleaved Thinking 能力

我们已在开放平台上为 MiniMax M2 及其 Interleaved Thinking 能力提供了最佳支持。为了获得最佳性能和兼容性,我们强烈建议使用我们的官方API。MiniMax 提供两种 API 接口:

OpenAI兼容API:

现在,当通过 MiniMax OpenAI兼容API调用M2模型时,可以用如下方式:

- 独立的

reasoning_details字段:模型的推理过程会在一个独立的reasoning_details字段中返回,不再与content混杂在一起。这使得 API 结构更清晰,也更易于解析。 - 完整的思维链:在后续请求中回传

reasoning_details字段,可以确保模型在多次工具调用中保持完整的思维链,从而做出更准确的判断和规划。(代码示例及更多详情请参阅官方手册)

Anthropic兼容API:

Anthropic API 原生支持 Interleaved Thinking,只需将模型每一轮的完整输出结果(包含thinking_blocks)添加到messages历史中,并在请求中发送给 API 即可。(更多详情请参阅官方手册)

推动行业标准,构建面向Agent的未来

除了在MiniMax开放平台官方API上支持Interleaved Thinking外,我们也在与OpenRouter、Ollama、Droid、Vercel、Cline等合作伙伴紧密合作,共同推进并实现这一功能的跨平台支持。通过与生态伙伴间的合作,我们希望能建立一个统一的协议范式,用于在应用、OpenAI 兼容API、Anthropic 兼容 API中广泛支持 Interleaved Thinking,从而为整个行业奠定基础。我们相信,开放统一的标准将赋能全球开发者,让他们能够轻松构建更强大、更可靠的Agent,推动AI生态繁荣发展。如需合作,请随时通过api@minimaxi.com与我们联系。

链接

1.OpenAI兼容API:

https://platform.minimaxi.com/docs/guides/text-m2-function-call#openai-sdk

2.Anthropic兼容API:

https://platform.minimaxi.com/docs/guides/text-m2-function-call#anthropic-sdk

3.MiniMax开放平台:

http://platform.minimaxi.com